- Politik

- OpenAI und Anduril

KI-Einhorn landet bei Militär

Schöpfer von ChatGPT steigt nach gelockerten Richtlinien in Verteidigungssektor ein

Anfang Januar zeichnete sich bei OpenAI eine entscheidende Wende ab: Das Unternehmen, das sich lange als Verfechter eines verantwortungsvollen Umgangs mit Künstlicher Intelligenz (KI) präsentiert hatte, lockerte in seinen Richtlinien das Verbot militärischer Anwendungen. Zwar will sich die Firma weiterhin nicht an der Entwicklung von Waffen beteiligen, erlaubt jedoch die Unterstützung der »nationalen Sicherheit«. Möglich sei eine Kooperation mit dem Militär etwa in den Bereichen Cybersicherheit, Katastrophenhilfe oder Suizidprävention.

Vor zwei Wochen gab OpenAI schließlich die Kooperation mit dem Militärtechnologie-Unternehmen Anduril bekannt. Gemeinsam wollen die beiden Firmen KI-Systeme entwickeln, die bei der Abwehr von Drohnenangriffen zum Einsatz kommen sollen. Laut Liz Bourgeois, Sprecherin von OpenAI, soll dies ausschließlich dem Schutz von US-Personal und -Einrichtungen dienen.

OpenAI, bekannt als Schöpfer von ChatGPT, trat 2015 mit dem Ziel an, friedliche KI zugunsten der gesamten Menschheit zu entwickeln. Ursprünglich als Non-Profit-Organisation gestartet, wandelte sich OpenAI 2019 in ein gewinnorientiertes Modell und begründete dies mit enormen Kosten für Forschung und Entwicklung.

Anduril Industries, der neue Partner von OpenAI, wurde 2017 vom Donald-Trump-Unterstützer Palmer Luckey gegründet. Die Firma wurde aber auch durch ihre Übernahme des umstrittenen Projekts »Maven« von Google bekannt; ein Programm, das KI zur Auswertung militärischer Drohnenaufnahmen einsetzt. Ähnlich wie OpenAI betont Anduril, dass ihre Technologien Leben retten soll, indem sie Gefahren für Soldat*innen abwehrt. Kurz nach Bekanntgabe der Kooperation mit OpenAI kündigte Anduril auch eine Partnerschaft mit dem für seine Geheimdienstkontakte berüchtigten Palantir-Konzern an.

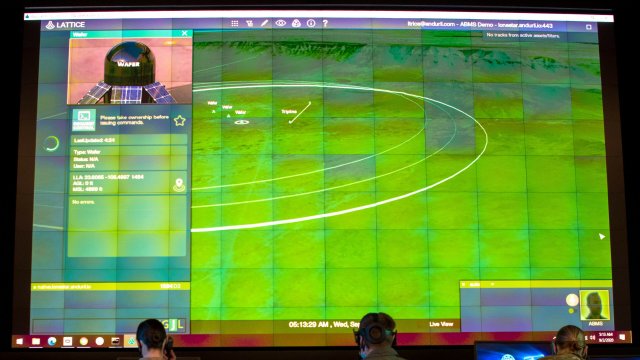

Auch die Plattform »Lattice« gehört zu Anduril, mit ihr konkurriert das Unternehmen direkt mit US-Rüstungsgiganten wie Lockheed Martin oder Northrop Grumman. Ihr »Battlefield-Management-System« wird außer an Militärbasen auch an den US-Grenzen eingesetzt. Es besteht aus solarbetriebenen Überwachungstürmen mit Kameras, Radar- und Infrarotsensoren sowie Drohnen. Das System scannt die Umgebung in 3D, überträgt Echtzeit-Aufnahmen von VR-Brillen und nutzt Bildanalysen, um Freund und Feind zu identifizieren. Luckey beschreibt diese Technologie als eine Art Videospiel-Interface. In seiner Vision werden Waffen nur noch von Soldat*innen ferngesteuert – unterstützt durch präzise KI-Analysen und Kriegsroboter.

Anduril stellt für die neue Partnerschaft mit OpenAI umfangreiche Datenbanken mit Informationen zu Drohnenbedrohungen bereit. OpenAIs Modelle sollen die Belastung menschlicher Operatoren bei der Analyse dieser Massendaten reduzieren und so das Situationsbewusstsein des Militärs verbessern. Die gemeinsame Plattform reduziere laut OpenAI »langweilige« Aufgaben für Soldat*innen.

Kritikerinnen wie die KI-Wissenschaftlerin Heidy Khlaaf warnen, dass Verteidigungstechnologien genauso auch offensiv eingesetzt werden könnten. So hat etwa der Ukraine-Krieg gezeigt, wie der tausendfache Einsatz von Drohnen zur Eskalation von Konflikten beiträgt. »Verteidigungswaffen sind in der Tat immer noch Waffen«, sagt Klaaf.

OpenAI und Anduril stellen ihre Partnerschaft auch in den Kontext eines intensiven Wettbewerbs zwischen den USA und China um die Vorherrschaft in der KI-Entwicklung. Andere Beobachter sehen darin aber auch den Versuch einer strategischen Neuausrichtung, da OpenAI unter anderem wegen einer Klage des früheren Investors Elon Musk unter hohem finanziellen Druck steht. Der Verteidigungssektor, bekannt für großzügige Budgets, könnte hier einen lukrativen Ausweg bieten. Andere Tech-Giganten wie Amazon, Google und der OpenAI-Investor Microsoft haben ihre Zusammenarbeit mit dem Pentagon bekanntlich längst ausgeweitet.

Vor einigen Jahren gab es innerhalb der Unternehmen mehrfach Widerstand gegen militärische oder geheimdienstliche Projekte; bekannt wurde dies etwa zu Googles Beteiligung an »Maven« mit dem Pentagon oder »Nimbus« mit Israels Militär. Diese Stimmen sind jedoch immer weniger zu hören. Viele einst aufmüpfige Silicon-Valley-Mitarbeiter*innen sehen womöglich die Bedrohung durch autoritäre Regime wie Russland oder China als Legitimation für die Unterstützung westlicher Streitkräfte und Geheimdienste. Darauf verweist auch ein Blogbeitrag von OpenAI vom 24. Oktober, der die Zusammenarbeit im Verteidigungsbereich mit demokratischen Werten wie Freiheit und Menschenrechten verknüpft. Die Formulierungen ähneln stark einem am selben Tag veröffentlichten US-Sicherheitsmemorandum, das den KI-Einsatz zur Abwehr von Konkurrenten wie China fordert.

Das »nd« bleibt. Dank Ihnen.

Die nd.Genossenschaft gehört unseren Leser*innen und Autor*innen. Mit der Genossenschaft garantieren wir die Unabhängigkeit unserer Redaktion und versuchen, allen unsere Texte zugänglich zu machen – auch wenn sie kein Geld haben, unsere Arbeit mitzufinanzieren.

Wir haben aus Überzeugung keine harte Paywall auf der Website. Das heißt aber auch, dass wir alle, die einen Beitrag leisten können, immer wieder darum bitten müssen, unseren Journalismus von links mitzufinanzieren. Das kostet Nerven, und zwar nicht nur unseren Leser*innen, auch unseren Autor*innen wird das ab und zu zu viel.

Dennoch: Nur zusammen können wir linke Standpunkte verteidigen!

Mit Ihrer Unterstützung können wir weiterhin:

→ Unabhängige und kritische Berichterstattung bieten.

→ Themen abdecken, die anderswo übersehen werden.

→ Eine Plattform für vielfältige und marginalisierte Stimmen schaffen.

→ Gegen Falschinformationen und Hassrede anschreiben.

→ Gesellschaftliche Debatten von links begleiten und vertiefen.

Seien Sie ein Teil der solidarischen Finanzierung und unterstützen Sie das »nd« mit einem Beitrag Ihrer Wahl. Gemeinsam können wir eine Medienlandschaft schaffen, die unabhängig, kritisch und zugänglich für alle ist.