Bringt der Storch die Babys?

Big Data zwischen Rationalität und Aberglaube

Da geht mal wieder ein Gespenst um, nicht nur in Europa, sondern vor allem im Silicon Valley. Es heißt Big Data und klingt verdächtig nach »Big Brother«. Was wird mit diesem Begriff nicht alles in Verbindung gebracht: totale Überwachung und Verhaltenskontrolle vorzugsweise durch amerikanische Internetkonzerne, Automatisierung unter dem Stichwort »Industrie 4.0« und die dadurch zu erwartende Arbeitslosigkeit, die völlige Verdatung des Menschen und sogar dessen Abschaffung oder - für viele die schlimmere Dystopie - die Abschaffung des Bargeldes. Big Data dreht Wahlkämpfe und installiert Präsidenten, verdrängt Mieter aus ihren Wohnungen, prekarisiert Taxifahrer und macht uns krank: Wenn der Burn-out nicht von alleine kommt, erledigt die allgegenwärtige Handystrahlung den Rest. Zeit, einen Schritt zurückzutreten und den Begriff Big Data nüchtern zu betrachten.

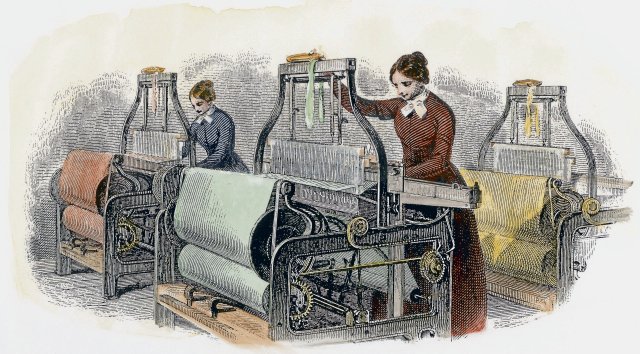

Big Data ist zunächst nichts weiter als die Analyse sehr großer Datenmengen, die nur schwach strukturiert sind. Die Technik stammt aus den Naturwissenschaften: Wenn eine Raumsonde Daten zur Erde funkt oder ein Teilchenbeschleuniger Informationen über die Zusammensetzung von Materie liefert, entstehen dabei so gewaltige Datenmengen, dass kein Mensch mehr in der Lage wäre, sie zu sichten und zu analysieren. Das erledigen Großrechner, die in den gewaltigen Datenbergen nach statistischen Auffälligkeiten fahnden. Ist eine gefunden, beginnt die eigentliche Arbeit: Handelt es sich um einen zufälligen statistischen Ausreißer oder sind die Forscher einem Phänomen auf der Spur, das Theorien stützt oder widerlegt? Handelt es sich um Korrelationen oder Kausalitäten? Vereinfacht gesagt: Wenn die Geburtenrate dort hoch ist, wo es viele Störche gibt, ist das ein Hinweis darauf, dass der Storch die Babys bringt?

Enno Park studierte Wirtschaftsinformatik und ist heute als Publizist für mehrere Medien tätig. In seinen Texten beschäftigt er sich u.a. mit den Auswirkungen des digitalen Wandels auf die Gesellschaft bis hin zur Verschmelzung von Mensch und Maschine. Seit einigen Jahren trägt er ein sogenanntes Cochlea-Implantat, mit dem er nach 22 Jahren Gehörlosigkeit wieder hören kann. Er bezeichnet sich selbst als Cyborg und war 2013 einer der Gründer des Cyborgs e.V. in Berlin.

Solche logischen Kurzschlüsse passieren ständig, wenn Menschen unvorsichtig mit statistischen Daten hantieren. Big-Data-Kritiker (und leider oft genug auch Analysten) vergessen, dass es sich bei Ergebnissen aus Big Data um statistische Daten handelt, die nur für eine große Gruppe von Menschen wahr sind, aber nicht für einzelne Individuen. Wenn die Werbewirtschaft Daten im Internet sammelt, um möglichst passend zugeschnittene Werbung einzublenden, interessiert sie sich überhaupt nicht dafür, ob jetzt Erika Mustermann oder Ekel Alfred vor dem Bildschirm sitzt. Ihr reicht es völlig, dass die Person mit hoher Wahrscheinlichkeit zur vorher festgelegten Zielgruppe gehört.

So behauptet die britische Analyse-Firma Cambridge Analytica, anhand von Facebook-Daten mit 88 Prozent Sicherheit feststellen zu können, ob ein Mensch homosexuell ist. Das klingt beeindruckend und gruselig, bedeutet aber auch, dass diese Erkennung bei 12 Prozent der Probanden fehlschlägt. Das Ergebnis der Analyse ist eben nicht, ob eine Person homosexuell ist oder nicht, sondern nur, wie viele Menschen einer großen Gruppe es mit einer bestimmten Wahrscheinlichkeit sind. Der einzelne Mensch ist am Ende bei weitem nicht so gläsern wie gedacht.

Der Glaube, anhand von Big Data sichere Aussagen über ein Individuum treffen zu können, ist daher ähnlich absurd wie Astrologie oder das Beispiel mit den Störchen und der Geburtenrate. Das hindert windige Geschäftemacher natürlich nicht daran, mit Big-Data-Astrologie Geschäfte zu machen. So bietet die Firma »38 Degrees North« ein Fitnesstraining an, das aufgrund der persönlichen Gene zusammengestellt wird. Dabei sind klare Kausalitäten gerade in der Genetik ziemlich selten. Wissenschaftlich fundiert sind nur Aussagen der Sorte: Sind bestimmte Gene vorhanden, ist die Wahrscheinlichkeit für Übergewicht um 20 Prozent erhöht. Statistische Aussagen über die Bevölkerung kann man so treffen, so jedoch ein individuelles Trainingsprogramm zusammenstellen zu wollen, grenzt an Scharlatanerie.

Seriös eingesetzt wird Big Data deshalb nur dort, wo es eben um solche statistischen Aussagen geht. So stellt das Berliner Start-up M-Sense eine App zur Migränevorhersage zur Verfügung. Wer an Migräne leidet, kann sich mit Hilfe der App vorhersagen lassen, ob sich mit bestimmter Wahrscheinlichkeit eine Attacke ankündigt - und Medikamente nehmen, bevor die Kopfschmerzen einsetzen.

Eine wesentlich größere Rolle spielt Big Data aber in Bereichen, wo es um große Gruppen von Menschen geht, etwa bei der Kreditvergabe. Banken benutzen ganze Datenbündel, um einen Score zu errechnen, um die Kreditwürdigkeit einer Person zu bestimmen. Dabei geht es aber nicht darum, ob diese einzelne Person wirklich kreditwürdig ist oder nicht, sondern nur darum, dass die Bank an eine große Zahl von Kunden insgesamt möglichst wenig faule Kredite vergibt. Nach der Banken- und Finanzkrise des letzten Jahrzehnts ist das durchaus eine gute Idee. Und wahrscheinlich ist eine Kreditvergabe auf Basis solcher Daten auch fairer als die Bauchentscheidung des Filialleiters der nächsten Kleinstadt-Sparkasse. Dass Kreditvergabe im Einzelfall oft ungerecht ist, liegt nicht am Scoring, sondern an der Ungerechtigkeit von Kreditvergabe im Kapitalismus an sich.

Am besten wäre es, den Begriff Big Data ganz aus der Diskussion zu nehmen. Er ist letztlich ein Marketing-Begriff, den Analysten benutzen, um ihre Dienstleistungen zu vermarkten. Vor allem wird er mit allerlei anderen Phänomenen assoziiert, die mit Big Data an sich wenig zu tun haben. Zum Beispiel Algorithmen, noch so ein Kampfbegriff aus der Gruselkiste. Dabei ist ein Algorithmus nichts weiter als eine Rechenanleitung, meist zur Entscheidungsfindung. Er kann auf Big-Data-Techniken fußen, muss aber nicht. Für den Algorithmus ist es egal, ob er von einem Menschen ausgerechnet wird oder von einem Computer. Am Ende steht eine Zahl, die gerne zur Entscheidungsfindung genutzt wird. Ein Algorithmus steckt dahinter, wenn eine Bank eine Kreditentscheidung fällt, genauso aber wenn sich ein Pfarrer entscheidet, einem Gemeindemitglied wegen kürzlich begangener Sünden die Eucharistie zu verweigern. Das Problem ist nicht der Algorithmus, sondern die Entscheidung an sich.

Natürlich wird per Algorithmus auch allerlei Unsinn produziert. Dahinter stecken aber meistens noch nicht einmal schlechte Absichten. Sexismus ist eben programmiert, wenn ein Software-Entwickler in der Datenbank nur genau die Einträge für »männlich« und »weiblich« vorsieht, aber keine weiteren Möglichkeiten - oder ganz auf die Erfassung dieses Datums verzichtet. So spiegeln die Computersysteme bewusst und vor allem auch unbewusst das Weltbild derjenigen, die sie entworfen haben. Und Menschen müssen dem System ein Schnippchen schlagen. So haben Mitarbeiter einer Bibliothek in Florida einen virtuellen Nutzer angelegt, der etliche Bücher pro forma ausleiht. Der Hintergrund: Eine Software listet die Bücher aus, die zu selten ausgeliehen werden. Die müssen dann von den Bibliotheken vernichtet werden, was regelmäßig dazu führt, dass ein Teil der Bücher später wieder neu angeschafft werden muss. Die Bibliotheksmitarbeiter überlisten mit ihrem Scheinkunden das System, um bestimmte Bücher im Bestand zu halten. Das Beispiel zeigt vor allem: Ein gewisses Selbstbewusstsein ist nötig, nicht alles, was ein Computer anzeigt, immer für bare Münze zu nehmen. Deshalb funktioniert Big Data auch so gut als Sündenbock: Wer glaubt, Donald Trump sei vor allem von sinistren Kampagnenmachern ins Amt manipuliert worden, muss sich nicht mehr damit auseinandersetzen, dass es letztlich eben doch Millionen Amerikaner waren, die ihn gewählt haben.

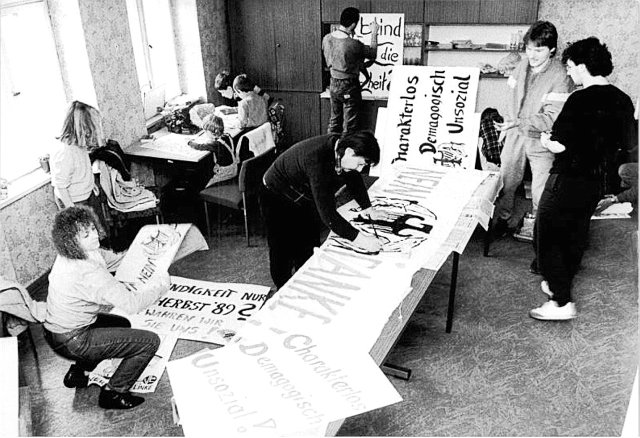

Digitalisierung ist die Automatisierung von Entscheidungen. Kafkaesk sind Situationen, in denen Menschen unfairen und undurchsichtigen Entscheidungen ausgeliefert sind, an denen sie nicht mitwirken können. Um so etwas zu beschreiben, brauchte Kafka keine Computer, keine Algorithmen und kein Big Data. Die Digitalisierung lässt sich nicht zurückdrehen, aber gestalten. Helfen würde Transparenz. Gruppen wie der Chaos Computer Club oder Algorithmwatch leisten hier wertvolle Arbeit. Sinnvoller als ein strengerer Datenschutz wären bessere Antidiskriminierungsgesetze. Wenn Big Data kafkaesk wird und Computeralgorithmen bürokratisch, technokratisch oder gar totalitär und diskriminierend eingesetzt werden, ist es die Aufgabe des Gesetzgebers, etwas dagegen zu unternehmen. Parteien, die das benennen wollen, tun gut daran, nicht ein nebulöses Big Data als Feind auszumachen, sondern eben Technokratie, Diskriminierung und Totalitarismus.

Das ist in Zeiten der Globalisierung ausgesprochen schwierig. Wer Facebook mehr Transparenz verordnen will, die Sozialgesetzgebung an die Geschäftsmodelle von Uber & Co. anpassen möchte oder von der Industrie Maschinensteuer und Arbeitszeitverkürzungen verlangt, um die Gesellschaft an den Automatisierungsgewinnen teilhaben zu lassen, wird schnell als naiv abgetan. Aber ist der Kampf gegen Big-Data-Windmühlen nicht noch sehr viel naiver?

Das »nd« bleibt. Dank Ihnen.

Die nd.Genossenschaft gehört unseren Leser*innen und Autor*innen. Mit der Genossenschaft garantieren wir die Unabhängigkeit unserer Redaktion und versuchen, allen unsere Texte zugänglich zu machen – auch wenn sie kein Geld haben, unsere Arbeit mitzufinanzieren.

Wir haben aus Überzeugung keine harte Paywall auf der Website. Das heißt aber auch, dass wir alle, die einen Beitrag leisten können, immer wieder darum bitten müssen, unseren Journalismus von links mitzufinanzieren. Das kostet Nerven, und zwar nicht nur unseren Leser*innen, auch unseren Autor*innen wird das ab und zu zu viel.

Dennoch: Nur zusammen können wir linke Standpunkte verteidigen!

Mit Ihrer Unterstützung können wir weiterhin:

→ Unabhängige und kritische Berichterstattung bieten.

→ Themen abdecken, die anderswo übersehen werden.

→ Eine Plattform für vielfältige und marginalisierte Stimmen schaffen.

→ Gegen Falschinformationen und Hassrede anschreiben.

→ Gesellschaftliche Debatten von links begleiten und vertiefen.

Seien Sie ein Teil der solidarischen Finanzierung und unterstützen Sie das »nd« mit einem Beitrag Ihrer Wahl. Gemeinsam können wir eine Medienlandschaft schaffen, die unabhängig, kritisch und zugänglich für alle ist.