- Wissen

- Sachbuch

Maschinen ohne Bewusstsein

Ob die Künstliche Intelligenz wirklich intelligent ist, darüber lässt sich streiten

In einer Simulation beobachteten Wissenschaftler kürzlich, wie sogenannte Sprachmodelle (also Programme, die ähnlich wie ChatGPT funktionieren) militärische und diplomatische Entscheidungen treffen. Diese eskalierten erstaunlich schnell und schreckten auch vor dem Einsatz von Atomwaffen nicht zurück.

Keine Frage: Der Einsatz der KI im militärischen Kontext ist gefährlich und die KI kennt weder menschliches (Mit-)Leid noch Moral. Solange die KI aber nicht automatisiert Waffen abfeuern kann, sind es immer noch Menschen, die über Leben und Tod entscheiden. Trotzdem: Angesichts derart vernichtender Einsatzbereiche muss uns die Frage umtreiben, wie intelligent Maschinen sein können, welche Autonomie eine solche Intelligenz erlangen kann und ob sie sich am Ende gegen die Menschheit an sich richten könnten.

Mit speziellen Einsatzbereichen der KI beschäftigt sich der Schriftsteller Michael Wildenhain in seinem kürzlich erschienenen ersten Sachbuch »Eine kurze Geschichte der Künstlichen Intelligenz« jedoch nicht. »Im Mittelpunkt steht die Frage, inwieweit KI-Systeme, bemessen am allgemein menschlichen Maßstab, als intelligent betrachtet werden können und ob vom Bewusstsein einer Maschine zu sprechen sinnvoll ist – oder nicht«, formuliert der Autor selbst das Anliegen seines Buches. Wildenhain, bekannt als Romanautor, schöpft dabei aus dem Fundus seiner Studienzeit der Informatik und Philosophie, lässt aber das Literarische in Form und Inhalt einfließen. Aufgebaut ist der kurze Band als eine Art Theaterstück in drei Aufzügen.

Mit unserem wöchentlichen Newsletter nd.DieWoche schauen Sie auf die wichtigsten Themen der Woche und lesen die Highlights unserer Samstagsausgabe bereits am Freitag. Hier das kostenlose Abo holen.

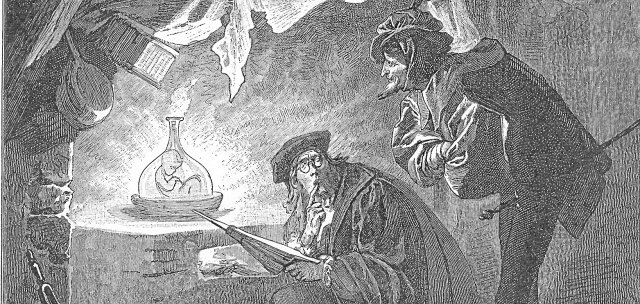

Im ersten Aufzug steigt er mit intelligenten, aber nicht menschlichen Geschöpfen der Literaturgeschichte ein, oder besser gesagt: mit der Angst vor solchen Wesen. Genannt werden hier der körperlose Homunkulus aus Goethes »Faust II« sowie Mary Shelleys »Frankenstein«. Beiden fiktiven Gestalten fehlt aber etwas, das für eine menschliche Intelligenz und ein menschliches Bewusstsein später als wesentlich verhandelt wird. Goethes Homunkulus als Geist in einer Phiole fehlt ein Körper, mit dem er mit den Dingen in der Welt interagieren könnte. Wir lernen im Laufe des kurzen Abrisses der KI-Geschichte einige Theoretiker kennen, denen zufolge menschliche Intelligenz nur mit einem »Körper-in-der-Welt« gedacht werden kann.

Shelleys literarisches Monster wiederum verfügt zwar über einen Körper, bleibt aber ausgeschlossen aus der menschlichen Gemeinschaft. Dieses ist technikgeschichtlich vielleicht analog zum Roboter, der zwar über einen Körper verfügt, aber ohne Verständnis für den Kontext einer Situation agiert.

Doch ist die »Künstliche Intelligenz« überhaupt eine Intelligenz? Der Informatiker John McCarthy ist der erste, der 1955 den Begriff der »Künstlichen Intelligenz« prägt, also noch in der Anfangsphase der Computerentwicklung. Im Zweiten Aufzug wird es sowohl mathematisch-technisch als auch philosophisch. Vorgestellt wird unter anderem der Kognitivismus, der das menschliche Gehirn mit einem Digitalcomputer gleichsetzt sowie die Gegenposition des Philosophen John Searle, dass die Informationsverarbeitung in Gehirn und Computer strukturell unterschiedlich abläuft. Der Konnektionismus wiederum glaubt, das menschliche Gehirn technisch in der Form von neuronalen Netzen nachbauen zu können. Die künstlichen Neuronen feuern je nachdem, ob sie das Eingangssignal 0 oder 1 erhalten. Auf diesem Weg einen digitalen Zwilling eines menschlichen Gehirns zu bauen, ist aber bislang nicht gelungen. Das 2023 beendete »Human Brain Project« konnte dieses Ziel jedenfalls nicht erreichen.

Die Erfolgsgeschichte der KI der letzten Jahre ereignete sich im Bereich der großen Sprachmodelle (Large Language Models), bekannt geworden in erster Linie mit dem Programm ChatGPT. Dieses Werkzeug vermag zwar eine sehr große Menge Sprache zu verarbeiten, darüber hinaus geht es ihm aber ein wenig wie dem Homunkulus: Es lebt nicht in der Welt, das heißt, es verfügt über keinerlei Faktenwissen und ist in keinen Kontext gestellt. So kann ein solches Sprachmodell vielleicht über Krieg und Frieden diskutieren, was eine Atombombe ist und welches Leid diese verursacht, doch es versteht nichts davon. »Aus sich heraus eine Intention zu entwickeln, zum Beispiel die Weltherrschaft zu übernehmen, liegt dem Chatbot oder dem KI-System fern. Es ›weiß‹ nichts von Weltherrschaft, es ›kennt‹ 0 und 1 und deren mannigfaltige Kombinationen«, schreibt Wildenhain.

Skeptische Geister mögen einwerfen: Noch nicht. Im dritten Aufzug betritt daher die Emergenz die Bühne. Diejenigen, die an die Emergenz glauben, nehmen an, dass durch die Zunahme der Komplexität eines Systems etwas Neues entstehen kann, das mehr ist als die Summe seiner Teile. Der Autor argumentiert dagegen, dass dies zum einen ein »eklatanter Verstoß gegen die kausale Geschlossenheit der physikalischen Welt« wäre, zum anderen dabei irgendwie ein Bewusstsein entstehen müsste, das nicht mit dem des Programmierers identisch ist.

Und letztlich landet man, so Wildenhain mit dem Emergenzproblem beim Leib-Seele-Dualismus der abendländischen Philosophie oder einer religiösen Thematik. Wenn wir uns fragen, ob die Maschine ein Bewusstsein entwickeln kann, dann müssen wir zunächst wissen, was das Bewusstsein überhaupt ist. Und wo der Intelligenzbegriff schon unscharf war, ist es der des Bewusstseins erst recht. Wenn das Bewusstsein aber materialistisch, das heißt, nicht außerhalb eines Körpers – und damit religiös – gedacht werden soll, dann kann das menschliche Bewusstsein nur eine »Autosuggestion« sein, die das menschliche Gehirn beständig erzeugt. Die Maschine hingegen, selbst wenn sie lernen sollte, sich selbst zu reproduzieren und zu programmieren, müsste stets von Menschen initiiert werden.

Wenn wir jedoch an geistige Entitäten glauben, die auch jenseits der physikalischen Welt existieren, dann können auch Maschinen intelligent sein und über ein Bewusstsein verfügen, befindet Wildenhain und verweist die Diskussion damit in die Sphäre der Theologie.

Michael Wildenhain: Eine kurze Geschichte der Künstlichen Intelligenz. Klett-Cotta 2024, 120 S., 16 €.

Das »nd« bleibt. Dank Ihnen.

Die nd.Genossenschaft gehört unseren Leser*innen und Autor*innen. Mit der Genossenschaft garantieren wir die Unabhängigkeit unserer Redaktion und versuchen, allen unsere Texte zugänglich zu machen – auch wenn sie kein Geld haben, unsere Arbeit mitzufinanzieren.

Wir haben aus Überzeugung keine harte Paywall auf der Website. Das heißt aber auch, dass wir alle, die einen Beitrag leisten können, immer wieder darum bitten müssen, unseren Journalismus von links mitzufinanzieren. Das kostet Nerven, und zwar nicht nur unseren Leser*innen, auch unseren Autor*innen wird das ab und zu zu viel.

Dennoch: Nur zusammen können wir linke Standpunkte verteidigen!

Mit Ihrer Unterstützung können wir weiterhin:

→ Unabhängige und kritische Berichterstattung bieten.

→ Themen abdecken, die anderswo übersehen werden.

→ Eine Plattform für vielfältige und marginalisierte Stimmen schaffen.

→ Gegen Falschinformationen und Hassrede anschreiben.

→ Gesellschaftliche Debatten von links begleiten und vertiefen.

Seien Sie ein Teil der solidarischen Finanzierung und unterstützen Sie das »nd« mit einem Beitrag Ihrer Wahl. Gemeinsam können wir eine Medienlandschaft schaffen, die unabhängig, kritisch und zugänglich für alle ist.